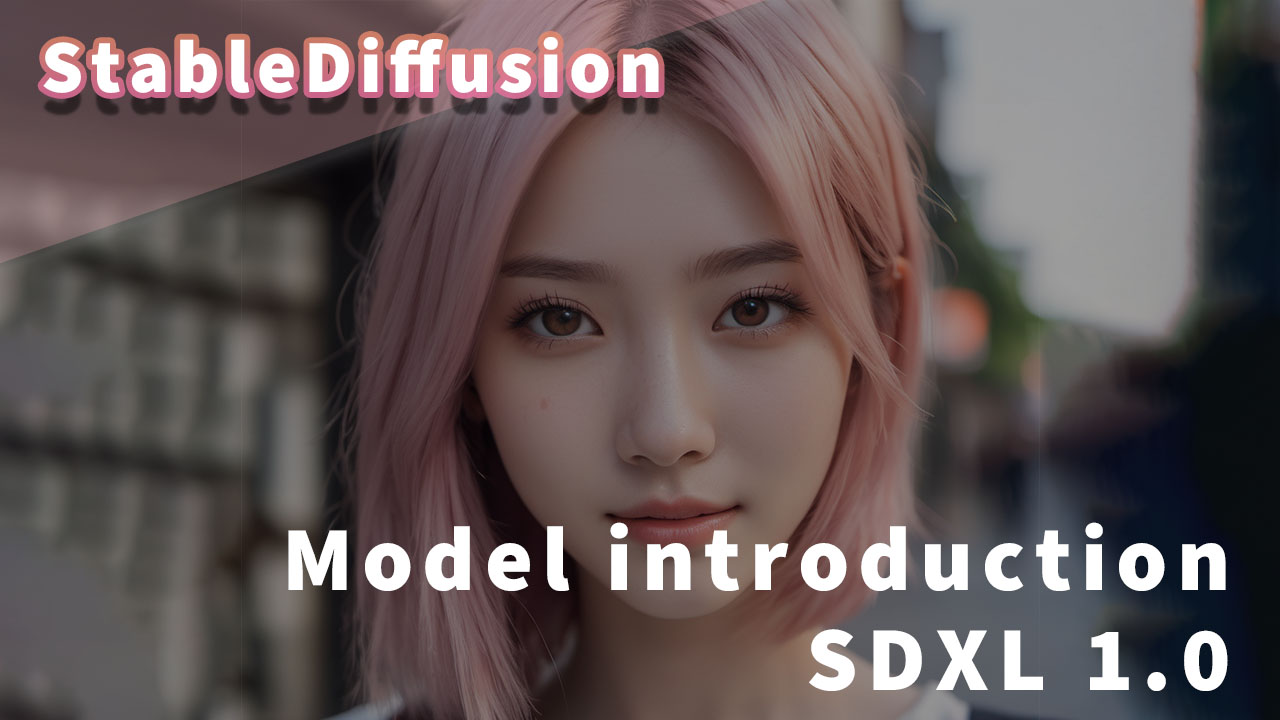

この記事ではバージョン1.0となったSDXLはどんな画像を生成できるのか、インストール方法から使い方、サンプル画像を紹介していきます。

- SDXL 1.0のインストール方法

- SDXL 1.0での画像生成手順

SDXL 1.0とは

SDXLはStability AIのフラッグシップモデルで今回公開された1.0が最新バージョンです。

Stable Diffusionのモデルは通常512*512の画像で学習されていますが、SDXL 1.0は1024*1024で学習されています。

また2pass対応しており、Base → Refinerと2回処理することにより、1pass式に比べて質感が向上しています。

Stable DiffusionをAUTOMATIC1111で使用している方が多いかと思いますが、

SDXL 1.0は通常のモデルと同じ感覚で使用できるので簡単に導入できますよ。

ダウンロード・インストールについて

以下手順でモデルをインストールします。

SDXL 1.0はcivitaiとHuggingFaceで公開されています。

またHuggingFaceではvaeも公開されています。

BaseモデルとRefinerモデルの2つをダウンロードしましょう。

vaeはなくても問題ありません。

Civitaiの公開先はこちら

(Civitaiではvaeが焼きこまれたモデルも公開されています)

HuggingFaceの公開先は以下の通りです。

SDXL 1.0 Base

SDXL 1.0 Refiner

SDXL Vae

ダウンロードしたモデルは「webui」→「models」→「Stable-diffusion」フォルダーに保存します。

vaeは「webui」→「models」→「VAE」フォルダーに保存します。

モデルの保存について詳しく知りたい方は↓の記事が参考になります。

SDXL 1.0の設定について

AUTOMATIC1111版web UIのバージョンについて

バージョン1.5.0以降のバージョンでSDXLに対応しています。

バージョンについてはWebUIの各タブ最下段に表示されています。

バージョンが古い場合は以下記事を参考にバージョンアップしましょう。

解像度設定など

SDXLの基本解像度は1024*1024です。

その他の設定については今まで通りで問題ありません。

以下はSDXL使用時のおすすめ解像度です。

- 1024 x 1024(1:1)

- 1152 x 896(4:3)

- 1344 x 768(16:9)

- 1536 x 640(12:5)

- 896 x 1152(3:4)

- 768 x 1344(9:16)

- 640 x 1536(5:12)

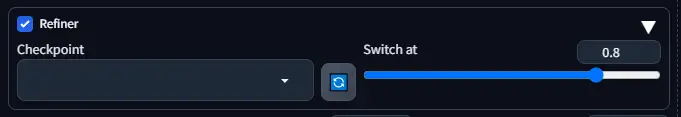

Refinerモデルの使用方法

txt2imgのGenerationタブにRefinerの設定項目があります。

右にある三角のボタンをクリックすると、設定項目が展開されます。

CheckpointでRefinerモデルを選択し、Switch atでBaseモデルからRefinerモデルに切り替わるポイントを設定します。

Refinerの詳細な使い方については以下記事で紹介しています。

VRAMについて

SDXL 1.0をStable Diffusion WebUIで動かすには8GBのVRAMでは足りません。

約9GB程度使用するので、NVIDIA製の現行GPUでは12GB以上のモデルが必要になります。

(RTX4000シリーズのVRAM 12GBのモデルは4070以上になり、非常に高価です)

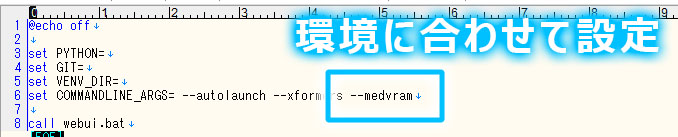

VRAMが少なく、SDXL 1.0で画像生成出来なかった場合は以下手順で動作させることが出来るかも・・・

Stable Diffusion WebUIの起動に使用している「webui-user.bat」を開いて、

COMMANDLINE_ARGSに以下コマンドのどちらかを追加してください。

(使用しているGPUのVRAMに合わせてlowvram、medvramどちらか選択してください)

--medvram--lowvram

lowvramは、より少ないVRAMに対応できますが、その分、画像生成速度が低下します。

SDXL 1.0のサンプル画像

いくつか画像を出力してみました。

何度かテストした感想としては、ネガティブプロンプトはシンプルに。

プロンプトについては、ロングワードが効果的です。

サイバーパンクなロボット

使用したプロンプトを確認する

masterpiece,best quality,ultra detailed,highres,absurdres,

Realistic photograph of cyborg in the cyberpunk citySFに登場するようなロボットをイメージしています。

このような画像の生成は得意ですね。

- Baseのみ

- Base+Refiner

以上の2種類で出力しました。

Baseのみでも綺麗ですが、Refinerを当てるとディテールが細かくなり、レイトレーシングを有効にしたように綺麗になりますね。

Refinerしゅごい

フォトリアル アジア人女性

使用したプロンプトを確認する

realistic close-up photograph of a 25yo Japanese 1girl with middle colored hair, realistic skin texture, detailed skin slight smile best quality, high quality, in the city, sun lights highly detailed, intricate, slight imperfections簡単に日本人女性が生成できるか試してみました。

使用したプロンプトは以下の通りです。

日本人女性かどうかは意見が分かれますが、Refinerを当てると肌の質感がアップします。

2Dイラスト女性

使用したプロンプトを確認する

anime artwork of a beautiful girl wearing office suit standing, anime style, key visual, vibrant, studio anime, highly detailed, in the office次はイラストの実力を確認しました。

Baseはぼやっとした印象ですが、Refinerを当てると解像度が上がったようにパリっとしました。

シャツの描写は微妙ですが、2D系のイラストでもかなり完成度高いです!

オブジェクト系(車)

使用したプロンプトを確認する

supercar, photoshoot, running at high speed, glowing lights, on the road, elegant minimalism, award winning photography,

extreme detail, illegal race car, extreme photorealistic, 8k, Hyper detailed car, perfect soft lighting, great lighting, car photography, fisheye lens, raining, reflection, absurdres, best quality, realistic style最後に人物以外のオブジェクトとして、車を生成しました。

はっきり言ってかっこいい!!!

金属の光沢についてはBaseの時点で素晴らしいですね。

Refinerの効果はロボットの時のような劇的な効果はありませんでした。

まとめ

今回は、Stability AIのStable DiffusionのSDXL 1.0を紹介しました。

VRAMの少ないグラボでも設定次第で動きますが、快適に使えるわけではありません。

RTX4070tiでも不足を感じるくらいです・・・

ローカル環境よりもGoogle Colabのようなクラウド上で実行するほうが良いかも。

その他にもおすすめのモデルを紹介しています。

YouTube動画も投稿しています。合わせてご参考ください。

コメント